-

ML class Note——回归

Step1:Models

Step2:Goodness of Function

如何寻找最优的Function

——利用Loss function L:

- Input: a funtion

- Output: how bad it is

L ( f ) = L ( ω , b ) L(f)=L(\omega,b) L(f)=L(ω,b)

Loss Funciton的选择本身也有很多种

在线性分类器中——通常使用预测值与真实值的偏差

L ( f ) = ∑ n = 1 N ( y ^ n − ( b + ω ∗ x c p n ) ) 2 L(f)=\sum_{n=1}^N(\hat{y}^n-(b+\omega*x^n_{cp}))^2 L(f)=n=1∑N(y^n−(b+ω∗xcpn))2

以输出的参数 ω 、 b \omega、b ω、b分别为y、x轴建立坐标系,颜色标为是函数的糟糕程度

——红色认为非常糟糕,蓝色认为较好

Step3:Best Function

找到最好的function的本质是,找到的这个函数,能够使得损失函数最小

——如何寻找这个使得损失函数最小的参数 ω \omega ω和 b b b

梯度下降寻找最优解

只要你的损失函数L(w,b)是可微分的,梯度下降就都可以处理这个函数

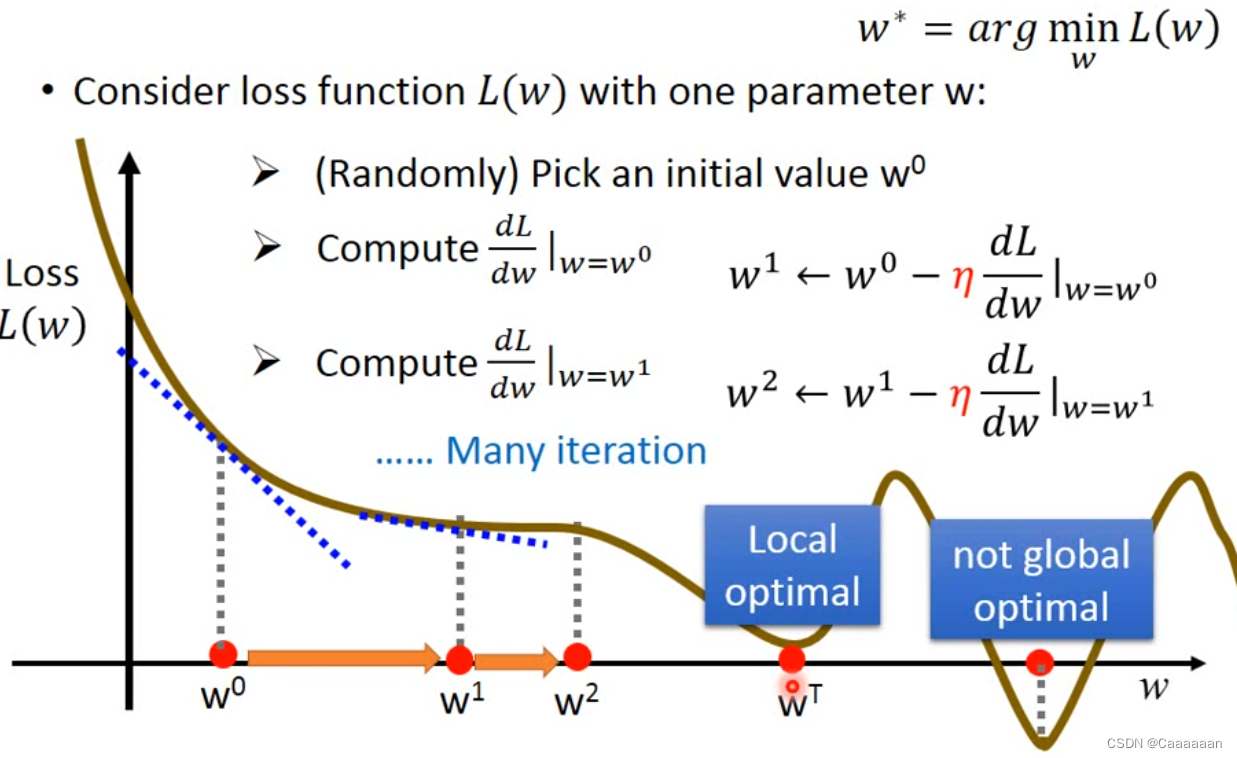

Consider loss function L( ω \omega ω) with one parameter w:

ω ∗ = a r g min ω L ( ω ) \omega^*=arg\min_\omega L(\omega) ω∗=argminωL(ω)

- 暴力法

穷举所有的 ω \omega ω,找到最小的那个

- Gradient Descent

- (Randomly) Pick an initial value ω 0 \omega^0 ω0

- Compute d L d ω ∣ w = w 0 \frac{dL}{d\omega}|_{w=w^0} dωdL∣w=w0

- 下一个迭代 w 1 = w 0 − η d L d ω ∣ w = w 0 w^1=w^0-\eta \frac{dL}{d\omega}|_{w=w^0} w1=w0−ηdωdL∣w=w0

因为如果梯度为正,说明前面的方向是往上走,我们就向后退

如果梯度为负,说明前面的方向是往下走,我们就向前走

η \eta η是学习率,决定了我们一个步子,迈多大

——达到某个局部最优点

幸运的是,Linear Regression没有Local optimal,只有Global optimal

How about two parameters?

Worry

我们的随机点位置,可能会使得我们只找到局部最优解,而无法获得全局最优解

幸运的是,Linear Regression没有Local optimal,只有Global optimal

重新寻找更好的Models

Selecting another Model

当你想拟合出更好的模型

引入二次项

y = b + ω 1 x c p + ω 2 ( x c p ) 2 y=b+\omega_1x_{cp}+\omega_2(x_{cp})^2 y=b+ω1xcp+ω2(xcp)2

引入更复杂的Model等等

y = b + ω 1 x c p + ω 2 ( x c p ) 2 + ω 3 ( x c p ) 3 y=b+\omega_1x_{cp}+\omega_2(x_{cp})^2+\omega_3(x_{cp})^3 y=b+ω1xcp+ω2(xcp)2+ω3(xcp)3

但是引入更复杂的Model后,可能会出现过拟合

A more complex model does not always lead to better performance on testing data.

Hidden Factors

只考虑原有cp值的影响是不对的,可能还要别的特征需要引入

Redesign the Model

对于每一种物种,有着不同参数的Linear Function

——讲物种特征,写入Function

对于哪些特征是有用的,是需要的,必要的,需要进行特征工程

例如这里,引入了特征有:类别,HP,Height,Weight

引入太多特征(可能是引入了冗余信息),会发现Overfitting了

- 方法一:如果你特征工程做得非常好,那你可以根据特征工程的结果,去减少一些特征的引入

- 方法二:Regularization

重新寻找更合适的Loss Function

Regularization——正则化

原始的Loss Function只考虑了预测值和真实值之间的差

Regularization就是加上一个额外的Term

y = b + ∑ ω i x i L = ∑ n ( y ^ n − ( b + ∑ ω i x i ) ) 2 + λ ∑ ( ω i ) 2 y=b+\sum\omega_ix_i\\ L=\sum_n(\hat{y}^n-(b+\sum\omega_ix_i))^2+\lambda\sum(\omega_i)^2 y=b+∑ωixiL=n∑(y^n−(b+∑ωixi))2+λ∑(ωi)2-

λ \lambda λ是一个需要调节的超参数

-

这个正则项的引入,说明了,我们希望 ω i \omega_i ωi越小越好

-

因为 ω i \omega_i ωi越小,这个拟合出来的函数,鲁棒性越强

-

λ \lambda λ越大,说明,这个函数越Smoother,我们就越考虑 ω i \omega_i ωi,而减少考虑error

我们需要调整 λ \lambda λ,来决定需要的函数有多Smooth

梯度下降代码

当学习率为0.000001时,随机梯度很难到达最优解的位置

当我们讲学习率调成0.00001时,这时的学习率又过大

因此,我们要给w和b不一样的学习率

特制化学习率之后,学习率随便设个1就好

import numpy as np import pandas as pd import matplotlib.pyplot as plt x_data=[338.,333.,328.,207.,226.,25.,179.,60.,208.,606.] y_data=[640.,633.,619.,393.,428.,27.,193.,66.,226.,1591.] # y_data=b+w*x_data x=np.arange(-200,-100,1)#bias y=np.arange(-5,5,0.1)#weight Z=np.zeros((len(x),len(y))) X,Y=np.meshgrid(x,y) for i in range(len(x)): for j in range(len(y)): b=x[i] w=y[i] Z[j][i]=0 for n in range(len(x_data)): Z[j][i]=Z[j][i]+(y_data[n]-b-w*x_data[n])**2 Z[j][i]=Z[j][i]/len(x_data) # y_data=b+w*x_data b=-120 #initial b w=-4 #initial w lr=1 #learning rate iteration=100000#最大迭代次数 # Store initial values for plotting b_history=[b] w_history=[w] lr_b=0 lr_w=0 # Iterations for i in range(iteration): b_grad=0.0 w_grad=0.0 for n in range(len(x_data)): b_grad=b_grad-2.0*(y_data[n]-b-w*x_data[n])*1.0 w_grad=w_grad-2.0*(y_data[n]-b-w*x_data[n])*x_data[n] lr_b+=b_grad**2 lr_w+=w_grad**2 # Update parameters #b=b-lr*b_grad #w=w-lr*w_grad b=b-lr/np.sqrt(lr_b)*b_grad w=w-lr/np.sqrt(lr_w)*w_grad # Store parameters for plotting b_history.append(b) w_history.append(w) #plot the figure plt.contourf(x,y,Z,50,alpha=0.5,cmap=plt.get_cmap('jet')) plt.plot([-188.4],[2.67],'x',ms=12,markeredgewidth=3,color='orange') plt.plot(b_history,w_history,'o-',ms=3,lw=1.5,color='black') plt.xlim(-200,-100) plt.ylim(-5,5) plt.xlabel(r'$b$',fontsize=16) plt.ylabel(r'$w$',fontsize=16) plt.show()- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

-

相关阅读:

【圆满落幕】IDCF社区&天津理工大学华信软件学院校友会技术沙龙丨IDCF

ROS2 中的轻量级、自动化、受控回放

【Flink入门修炼】1-1 为什么要学习 Flink?

OC-手动引用计数内存管理

【Java】异常

LeetCode每日一题(2095. Delete the Middle Node of a Linked List)

【设计模式】Java设计模式 - 桥接模式

【单源最短路 图论】3112. 访问消失节点的最少时间

药品销售数据查询的网站都有哪些?< 市场竞争调研>

图像处理ASIC设计方法 笔记6 数据拼接和帧格式校正

- 原文地址:https://blog.csdn.net/Hacker_ccc/article/details/126909881