-

Pytorch 实战 LESSON 5 基本优化方法与最小二乘法

简单线性回归

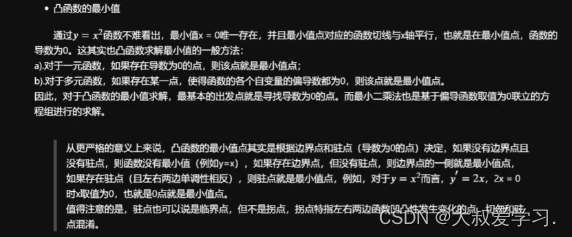

凸函数最小值,就是凸优化的问题之一。最小二乘是最基础和经典的方法,求解目标函数最优化的问题的数学工具。

最小二乘是寻找凸函数最小值的优化方法。SSE本身是一个凸函数,所以一个函数的凹凸性决定了我们求解的策略。当我们不了解目标函数是什么的时候,不能盲目使用优化方法,比如最小二乘,有自己的局限性。所以梯度下降是更普遍的。

机器学习建模思路

机器学习是样本探寻总体,涉及大量数据样本的分布等。建模的思路和统计分析建模有区别,机器学习更看重通过优化方法来找到最优解。统计学模型要先考虑概率,分布。机器学习流派先讨论优化思想。神经网络更加通用和复杂。机器学习是我们挑选一些好的模型,选择,然后进行调参和优化。但是深度学习我们一般都是用神经网络,对神经网络结构进行优化。

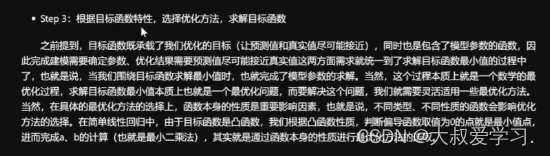

所以我们说,任何建模的第一步,都是提出基本的模型,第二步就是确定损失函数。第三步,根据目标函数,选择优化方法,求解。第一优化方法:最小二乘

最小二乘法有点:迅速找到最小值点,缺点是:使用的条件比较苛刻。

公式里是2范数,也就是平方和再开平方。2范数上面还有一个平方,所以就是所有误差的平方和了。

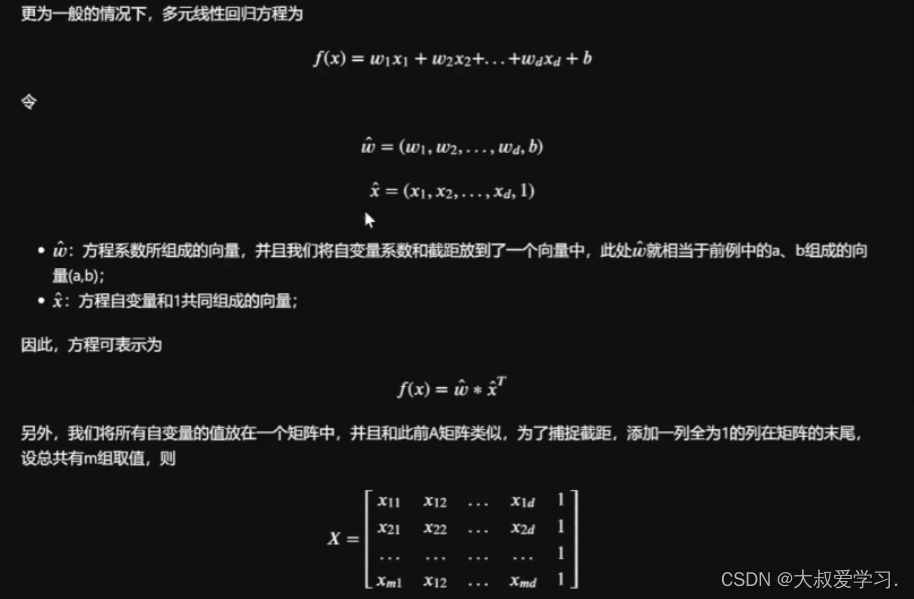

如果是多元线性回归,方程组求解就非常困难了,这时候就用矩阵的方法求解。俩者都是最小二乘的方法。也就求导数为0的驻点。

L1是各个分量绝对值得和。autograd求导

-

相关阅读:

【最优化理论】03-无约束优化

JavaWeb 学习笔记 7:Filter

javaer你还在手写分表分库?来看看这个框架怎么做的 干货满满

springboot使用redis

从零开始搭建React+TypeScript+webpack开发环境-基于lerna的webpack项目工程化改造

protobuf 基本语法总结

tslib編译和安装

[附源码]java毕业设计票务销售网站

薅羊毛-微信阅读

长安链fact示例合约statedb存储数据原文带有cmecv1.0原因分析

- 原文地址:https://blog.csdn.net/weixin_43716712/article/details/126358630