-

深入探讨 AutoGPT:彻底改变游戏的自主 AI

原文地址:Deep Dive into AutoGPT: The Autonomous AI Revolutionizing the Game

2023 年 4 月 24 日

AutoGPT 是一个功能强大的工具,它通过 API 使用 GPT-4 和 GPT-3.5,通过将项目分解为子任务并在自动循环中使用互联网和其他工具来创建完整的项目。

在本文中,我们将探讨您需要了解的有关 AutoGPT 的所有信息,包括它是什么、它如何工作以及它的优点和局限性。

为了有效地使用 AutoGPT,了解其反馈循环的工作原理非常重要。在本文中,我们将探讨 AutoGPT 反馈循环的核心以及如何使用它来提高 AutoGPT 的准确性和有效性

什么是 AutoGPT?

AutoGPT 是一种人工智能代理,它可以尝试通过将自然语言分解为子任务并在自动循环中使用互联网和其他工具来实现目标。

它使用 OpenAI 的 GPT-4 或 GPT-3.5 API,是使用 GPT-4 执行自主任务的应用程序的首批示例之一。AutoGPT 是一个功能强大的工具,可以自动快速高效地生成高质量内容的过程。

它是使用 GPT-4 执行自主任务的应用程序的首批示例之一。AutoGPT 可用于各种任务,包括研究、编码和故事改进。

AutoGPT 反馈循环的核心

AutoGPT 是一款人工智能驱动的应用程序,旨在通过一系列旨在优化性能和准确性的步骤彻底改变我们解决问题的方式。

在这里输入要转换的内容AutoGPT的一个关键特点是其反馈循环,该循环包括五个关键步骤:计划、评论、行动、阅读反馈和计划。在本文中,我们将解释每个步骤及其在AutoGPT反馈循环中的重要性。

AutoGPT 反馈循环的核心

AutoGPT 的主要功能之一是其反馈循环,它由五个关键步骤组成:计划、批评、行动、阅读反馈和计划。在本文中,我们将解释每个步骤及其在 AutoGPT 反馈循环中的重要性。

- 计划:AutoGPT 制定一个计划来实现预期结果,将复杂的任务分解为更小的步骤。

- 批评:评估计划的可行性和效率,确定潜在问题和需要改进的领域。

- 行动:AutoGPT 使用其多功能功能(例如网页浏览和数据检索)执行计划的操作。

- 阅读反馈: AutoGPT 分析其操作生成的反馈,从之前的表现中学习以改善未来的结果。

- 计划(修订):根据反馈,对最初的计划进行修订,从而不断完善解决问题的策略。

其中每个步骤对于 AutoGPT 的整体有效性都至关重要,了解它们如何协同工作是有效使用 AutoGPT 的关键。

Auto-GPT 背后的机制是什么?

Auto-GPT 背后的机制以 GPT-4 或 GPT-3.5 API 的使用为中心。这些强大的语言模型是人工智能代理的基础,使其能够理解和处理自然语言目标。通过将这些目标分解为更小的、可管理的子任务,Auto-GPT 可以有效地解决复杂的问题。

通过自我提示实现自主

Auto-GPT 的主要功能之一是它的自我提示能力。

Auto-GPT — 通过自我提示实现自治

这意味着人工智能代理可以在最少的人工干预下运行,使其成为适用于广泛应用的多功能且有用的工具。

Auto-GPT 的自我提示功能使其能够根据新信息或资源调整其方法,从而能够导航任务并实现所需的结果。

互联网和工具集成

为了进一步增强其能力,Auto-GPT还利用互联网和各种工具来协助完成任务。

这种集成使人工智能代理能够访问丰富的信息和资源,确保它能够找到最相关和最准确的数据来支持其解决问题的过程。

AutoGPT如何工作?

AutoGPT 由 GPT-3.5 提供支持,这是一种最先进的语言模型,能够生成各种样式和格式的高质量文本。它可用于自动化各种任务,从撰写文章到生成代码。

它首先迭代自己的提示,并在每次迭代中以它们为基础,这使得人工智能能够根据以前的工作产生新的想法和概念。

三个关键输入

AutoGPT需要用戶提供三個主要輸入:

- AI名称

- AI角色

- 最多五個目標

AI 名称和 AI 角色定义了 AI 代理的具体目的和功能,而目标则提供了要完成的任务的清晰轮廓。

执行代理人

每项任务均由“执行代理”(GPT-4) 管理,该代理向一个或多个其他 GPT-4 代理提供输入[ 4 ]。这种方法允许添加由代理完成的新子任务,最终使 AutoGPT 能够解决复杂的任务并实现预期的结果。

推理阶段

一旦生成提示,AutoGPT 就会进入“推理”阶段[ 5 ]。在此阶段,人工智能分析提示并制定计划以实现预期结果。该过程涉及将提示分解为更小的子任务,然后人工智能自动执行这些子任务。

如何安裝和運行Auto-GPT

Auto-GPT 是一个实验性开源应用程序,它利用 GPT-4 和 GPT-3.5 的强大功能来自主执行任务,无需人工输入。

步骤 1:设置 API 密钥

在安装 Auto-GPT 之前,您需要获取OpenAI 的 API 密钥。

步骤 2:安装自动 GPT

要安装 Auto-GPT,您需要从 GitHub 上的官方存储库下载该应用程序

打开终端并运行以下命令:

$ git clone https://github.com/your-repository/auto-gpt.git

接下来,导航到下载的文件夹并使用以下命令安装所需的软件包:

$ cd auto-gpt $ pip install -r requirements.txt

步骤 3:使用 API 密钥配置 Auto-GPT

安装 Auto-GPT 并定义 AI 的角色和目标后,您将需要使用 OpenAI 和 PineCone API 密钥配置应用程序。

config.yaml使用文本编辑器再次编辑配置文件(例如),并在相应字段中输入您的 API 密钥。保存文件并关闭文本编辑器。步骤 4:运行 Auto-GPT 并监控结果

一切设置完毕后,您现在可以运行 Auto-GPT 并让它自主执行任务。要运行 Auto-GPT,请使用以下终端命令:

$ python auto_gpt.py or $ ./run.sh

监控结果并在必要时向人工智能提供反馈,以改进其性能并提高其对给定目标的理解。

Auto GPT的局限性

Auto-GPT 缺乏将一系列操作转换为可重用函数以供以后使用的能力,这使得用户每次想要解决问题时都从头开始,效率低下且成本高昂。

与现实世界中解决问题相比,这种限制凸显了不切实际的期望,既浪费时间又浪费金钱。

不幸的是,Auto-GPT 当前的实现不允许开发和生产分离,迫使用户为微小的更改支付全部成本。

这引起了人们对其在现实环境中的实用性的担忧,并凸显了其在为大规模问题解决提供可持续且具有成本效益的解决方案方面的局限性。

Auto-GPT 真的免费吗?

Auto-GPT 提供了令人印象深刻的功能,但其高昂的成本对其在生产环境中的实际使用构成了重大障碍。Auto-GPT 所依赖的 GPT-4 模型可能会很昂贵,因为任务中的每个步骤都需要调用该模型,而该模型通常会最大化令牌以提供更好的推理和提示。GPT-4 代币的提示费用为每 1,000 个代币 0.03 美元,结果的费用为每 1,000 个代币 0.06 美元。例如,一个需要 50 个步骤的小任务,每个步骤都最大化 8K 上下文窗口,将花费 14.4 美元。

这种成本会迅速增加,使得许多组织和用户无法承受当前的 Auto-GPT 实施。虽然 Auto-GPT 显示出巨大的前景,但其成本是一个重大障碍,需要在广泛采用之前解决。

ChatGPT 和 Auto-GPT 之间的主要区别

ChatGPT 和 Auto-GPT 应用程序基于生成式预训练 Transformer (GPT) 技术构建。

虽然 ChatGPT 和 Auto-GPT具有共同的基础,但它们在功能和用途上存在显着差异。

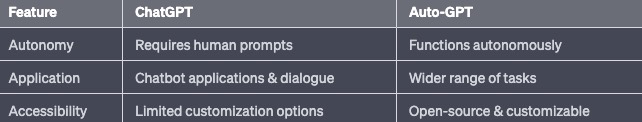

ChatGPT 和 Auto-GPT 的区别、自治性、应用性和可访问性

1.自主性:

ChatGPT 和 Auto-GPT 之间最显着的区别之一在于它们的自治程度。

ChatGPT 主要为聊天机器人应用程序设计,需要人工提示才能生成响应并完成任务。

另一方面,自动 GPT 可以在无需人工干预的情况下自主运行。它会生成自己的提示来实现给定的目标,使其能够在没有持续指导的情况下独立完成任务。

2.申请

ChatGPT专为对话而设计和优化,使其成为聊天机器人应用程序的理想选择。

相反, Auto-GPT旨在自主执行更广泛的任务。它可以访问网站和搜索引擎来收集完成任务所需的数据,使其成为用于各种目的的多功能工具。

3.辅助功能

Auto-GPT是一个开源项目,允许开发人员自由修改其代码并根据自己的特定需求进行定制。

但是, ChatGPT可能有更多限制,具体取决于访问它的平台。

最后,为什么我停止使用 AutoGPT?

总而言之,我对 AutoGPT 的初步体验非常令人印象深刻,因为它能够理解我的目标、自动生成提示并从互联网获取最新信息。简单易用,加上互联网连接,使其成为自动化任务和提高生产力的有吸引力的工具。

然而,在使用 AutoGPT 几天后,我发现了一些限制,导致我停止使用它。首先,AutoGPT 的运行速度可能很慢,从互联网上抓取和分析几篇文章最多需要 2-4 分钟,而手动搜索和选择文章大约需要一分钟。其次,与 AutoGPT 相关的成本可能相当高,尤其是在使用 OpenAI API 时。仅仅一天早上,我就在 API 使用上花费了 1 美元。

总而言之,虽然 AutoGPT 在自动化任务和提高生产力方面具有一些显着的功能和潜力,但其在速度和成本方面的局限性可能会阻止一些用户长期使用它。用户在广泛使用 AutoGPT 之前应仔细评估自己的需求、要求和预算。

参考

Auto-GPT: Understanding its Constraints and Limitations - AutoGPT Official

AutoGPT: Everything You Need To Know - KDnuggets

https://medium.com/r?url=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FAuto-GPT

What is Auto-GPT? Everything to know about the next powerful AI tool | ZDNET

Auto GPT vs ChatGPT: What's the difference?

Auto-GPT vs ChatGPT: How Do They Differ and Everything You Need to Know - AutoGPT Official

总结

AutoGPT是一种利用GPT-4模型的自动化任务处理系统,其主要特点包括任务分配、多模型协作、互联网访问和文件读写能力以及上下文联动记忆性。其核心思想是通过零样本学习(Zero Shot Learning)让GPT-4理解人类设定的角色和目标,并通过多任务学习(Multi-task Learning)实现任务拆解和子任务分配。

AutoGPT利用GPT-4的零样本学习能力,让模型在没有接触过特定类别样本的情况下,仍然能够识别和处理这些类别的数据。例如,如果一个零样本学习模型被训练识别动物,并已经学会识别“猫”和“狗”这两个类别,那么当它遇到一个未见过的动物类别(如“狼”)时,可以根据“狼”和已知类别的语义表示之间的相似性,正确地识别出“狼”。

在任务分配方面,AutoGPT利用多任务学习的方法,通过让模型在一个统一的框架下学习多个相关任务,实现知识的共享和迁移,从而提高模型的性能。例如,在自然语言处理(NLP)领域,一个多任务学习模型可能需要同时学习词性标注(Part-of-speech tagging)、命名实体识别(Named Entity Recognition)和情感分析(Sentiment Analysis)等任务。

AutoGPT还具备提示生成能力,它可以通过少量样本学习的方法自动生成提示,从而完成更多任务。例如,如果想要GPT帮我制作一个关于AIGC科普类的视频,我们可以先给它一些关于AIGC的文章、或者其他科普类视频的结构,让它学习到什么是aigc、什么是科普,然后利用这些知识来创作一个全新的AIGC相关的科普视频。

在评估子任务是否达标方面,AutoGPT能够利用元学习(Meta-learning)自我评估和改进,从而实现更复杂和多步骤的任务,降低对人类提示的依赖。例如,我让它写一个营销文案,根据结果给出反馈:“文案写得很好,但有些地方不够吸引人,没有触达用户的决策点,希望你可以再详细一些。”Auto GPT 根据这个反馈修改和完善文案。

AutoGPT优势

- 用于搜索和信息收集的互联网接入 / Internet access for searches and information gathering

- 长期和短期内存管理 / Long-term and short-term memory management

- 用于文本生成的 / GPT-4实例GPT-4 instances for text generation

- 访问热门网站和平台 / Access to popular websites and platforms

- 使用GPT-3.5进行文件存储和摘要 / File storage and summarization with GPT-3.5

- 插件扩展性 / Extensibility with Plugins

- 首先,用户需要提供一个任务和目标,然后这个任务会被添加到任务队列中。

- 接下来,执行代理(Execution Agent)会从任务队列中取出任务,并将其发送给任务创建代理(Task Creation Agent)。任务创建代理会查询内存中的上下文信息,并根据这些信息来创建一个新的任务。

- 然后,这个新创建的任务会被存储在内存中,并且执行代理会将任务的结果发送回任务队列中。

- 最后,任务优先级代理(Task Prioritization Agent)会根据任务的优先级来清理任务列表,并将清理后的任务列表返回给用户。

- 整个过程都是通过内存来实现的,内存可以存储任务/结果对,并且可以根据上下文信息来查询任务。

AutoGPT 利用 GPT-4 来实现自动任务处理和目标达成的高级应用。其主要特点包括:

- 零样本学习(Zero-Shot Learning):AutoGPT 能够理解并执行未曾训练过的特定角色和目标,这是通过 GPT-4 的零样本学习能力来实现的。这种能力使得模型无需接触过某个任务的具体样例,仅凭概念描述或定义就能理解和生成相应内容。

- 多任务处理与拆解:对于人类设定的目标,AutoGPT 利用多任务学习的方法将其分解成一系列子任务。可以通过对任务目标的理解以及内在的推理能力,将复杂任务结构化为可执行的多个步骤。

- 互联网访问与文件操作:AutoGPT 具备直接访问互联网资源及读写文件的能力,这有助于在执行任务时获取必要信息和保存进度。

- 上下文联动记忆性:能够捕捉和利用之前交互的上下文信息,以维持连贯的任务执行过程。

- 提示自动生成:AutoGPT 使用了类似“few-shot learning”的技术,通过元学习、数据增强等策略,在有限的示例基础上生成新的提示,让 GPT-4 完成更多复杂的任务。

- 自我评估与改进:Auto GPT 可以通过元学习进行自我评估,并基于任务表现结果不断优化自己的提示生成和执行策略。当分配给 GPT-4 的子任务完成后,会根据反馈和结果调整后续步骤,例如从用户评价中学习如何改进文案写作。

- 子任务达标评估:Auto GPT 根据预先设定的目标,结合来自数据库的数据,生成并执行针对 GPT-4 的提示。同时,它也会利用生成的输出和外部反馈(如用户的评价)判断子任务是否完成,从而进行迭代改进。

- 核心代码在于prompt构造:尽管 AutoGPT 在演示上很吸引人,但其核心技术在于如何构建有效的提示信息,即将用户输入的角色、目标等合并到默认的提示消息中。

- 局限性与CoT方法:AutoGPT 在推理能力方面未充分利用“链式思考转换”(Chain of Thought, CoT) 方法,导致在解决需要复杂推理的问题时表现出一定的局限性,可能会陷入循环或重复操作,尤其是在token计费背景下,这一问题更为突出。

-

相关阅读:

学习servlet【续】

JVM运行时数据区——虚拟机栈

大学生川菜网页制作教程 学生HTML静态美食菜品网页设计作业成品 简单网页制作代码 学生美食网页作品免费设计

CSS的美化(文字、背景) Day02

docker搭建maven私服

2022年6月PMP考试,大家觉得考的怎么样?我3A通过了

ES6 - 剩余参数,Array的扩展方法,String的扩展方法

ElasticSeach的Api操作学习

zookeeper典型使用场景

pcl--第四节 采样一致性算法RANSAC

- 原文地址:https://blog.csdn.net/lichunericli/article/details/136454082