-

云原生Kubernetes:K8S集群list-watch机制与 pod调度约束

目录

一、理论

1.K8S的list-watch 机制

(1)概念

Kubernetes 是通过 List-Watch 的机制进行每个组件的协作,保持数据同步的,每个组件之间的设计实现了解耦。

用户是通过 kubectl 根据配置文件,向 APIServer 发送命令,在 Node 节点上面建立 Pod 和 Container。

APIServer 经过 API 调用,权限控制,调用资源和存储资源的过程,实际上还没有真正开始部署应用。这里 需要 Controller Manager、Scheduler 和 kubelet 的协助才能完成整个部署过程。在 Kubernetes 中,所有部署的信息都会写到 etcd 中保存。实际上 etcd 在存储部署信息的时候,会发送 Create 事件给 APIServer,而 APIServer 会通过监听(Watch)etcd 发过来的事件。其他组件也会监听(Watch)APIServer 发出来的事件。

(2)Pod 的典型启动过程

Pod 是 Kubernetes 的基础单元,Pod 启动典型创建过程如下:

- (1)这里有三个 List-Watch,分别是 Controller Manager(运行在 Master),Scheduler(运行在 Master),kubelet(运行在 Node)。他们在进程已启动就会监听(Watch)APIServer 发出来的事件。

- (2)用户通过 kubectl 或其他 API 客户端提交请求给 APIServer 来建立一个 Pod 对象副本。

- (3)APIServer 尝试着将 Pod 对象的相关元信息存入 etcd 中,待写入操作执行完成,APIServer 即会返回确认信息至客户端。

- (4)当 etcd 接受创建 Pod 信息以后,会发送一个 Create 事件给 APIServer。

- (5)由于 Controller Manager 一直在监听(Watch,通过http的8080端口)APIServer 中的事件。此时 APIServer 接受到了 Create 事件,又会发送给 Controller Manager。

- (6)Controller Manager 在接到 Create 事件以后,调用其中的 Replication Controller 来保证 Node 上面需要创建的副本数量。一旦副本数量少于 RC 中定义的数量,RC 会自动创建副本。总之它是保证副本数量的 Controller(PS:扩容缩容的担当)。

- (7)在 Controller Manager 创建 Pod 副本以后,APIServer 会在 etcd 中记录这个 Pod 的详细信息。例如 Pod 的副本数,Container 的内容是什么。

- (8)同样的 etcd 会将创建 Pod 的信息通过事件发送给 APIServer。

- (9)由于 Scheduler 在监听(Watch)APIServer,并且它在系统中起到了“承上启下”的作用,“承上”是指它负责接收创建的 Pod 事件,为其安排 Node;“启下”是指安置工作完成后,Node 上的 kubelet 进程会接管后继工作,负责 Pod 生命周期中的“下半生”。 换句话说,Scheduler 的作用是将待调度的 Pod 按照调度算法和策略绑定到集群中 Node 上。

- (10)Scheduler 调度完毕以后会更新 Pod 的信息,此时的信息更加丰富了。除了知道 Pod 的副本数量,副本内容。还知道部署到哪个 Node 上面了。并将上面的 Pod 信息更新至 API Server,由 APIServer 更新至 etcd 中,保存起来。

- (11)etcd 将更新成功的事件发送给 APIServer,APIServer 也开始反映此 Pod 对象的调度结果。

- (12)kubelet 是在 Node 上面运行的进程,它也通过 List-Watch 的方式监听(Watch,通过https的6443端口)APIServer 发送的 Pod 更新的事件。kubelet 会尝试在当前节点上调用 Docker 启动容器,并将 Pod 以及容器的结果状态回送至 APIServer。

- (13)APIServer 将 Pod 状态信息存入 etcd 中。在 etcd 确认写入操作成功完成后,APIServer将确认信息发送至相关的 kubelet,事件将通过它被接受。

- 注意:在创建 Pod 的工作就已经完成了后,为什么 kubelet 还要一直监听呢?原因很简单,假设这个时候 kubectl 发命令,要扩充 Pod 副本数量,那么上面的流程又会触发一遍,kubelet 会根据最新的 Pod 的部署情况调整 Node 的资源。又或者 Pod 副本数量没有发生变化,但是其中的镜像文件升级了,kubelet 也会自动获取最新的镜像文件并且加载。

(3) 调度过程

Scheduler 是 kubernetes 的调度器,主要的任务是把定义的 pod 分配到集群的节点上。其主要考虑的问题如下:

- 公平:如何保证每个节点都能被分配资源

- 资源高效利用:集群所有资源最大化被使用

- 效率:调度的性能要好,能够尽快地对大批量的 pod 完成调度工作

- 灵活:允许用户根据自己的需求控制调度的逻辑

调度分为几个部分:

- 首先是过滤掉不满足条件的节点,这个过程称为预算策略(predicate)

- 然后对通过的节点按照优先级排序,这个是优选策略(priorities);

- 最后从中选择优先级最高的节点。如果中间任何一步骤有错误,就直接返回错误。

① 预算策略(predicate)

Predicate 有一系列的常见的算法可以使用:

- PodFitsResources:节点上剩余的资源是否大于 pod 请求的资源。

- PodFitsHost:如果 pod 指定了 NodeName,检查节点名称是否和 NodeName 匹配。

- PodFitsHostPorts:节点上已经使用的 port 是否和 pod 申请的 port 冲突。

- PodSelectorMatches:过滤掉和 pod 指定的 label 不匹配的节点。

- NoDiskConflict:已经 mount 的 volume 和 pod 指定的 volume 不冲突,除非它们都是只读。

② 优选策略(priorities)

如果在 predicate 过程中没有合适的节点,pod 会一直在 pending 状态,不断重试调度,直到有节点满足条件。 经过这个步骤,如果有多个节点满足条件,就继续 priorities 过程:按照优先级大小对节点排序。

优先级由一系列键值对组成,键是该优先级项的名称,值是它的权重(该项的重要性)。有一系列的常见的优先级选项包括:

- LeastRequestedPriority:通过计算CPU和Memory的使用率来决定权重,使用率越低权重越高。也就是说,这个优先级指标倾向于资源使用比例更低的节点。

- BalancedResourceAllocation:节点上 CPU 和 Memory 使用率越接近,权重越高。这个一般和上面的一起使用,不单独使用。比如 node01 的 CPU 和 Memory 使用率 20:60,node02 的 CPU 和 Memory 使用率 50:50,虽然 node01 的总使用率比 node02 低,但 node02 的 CPU 和 Memory 使用率更接近,从而调度时会优选 node02。

- ImageLocalityPriority:倾向于已经有要使用镜像的节点,镜像总大小值越大,权重越高。

(4)指定调度节点

①使用nodeName 强制匹配

pod.spec.nodeName 将 Pod 直接调度到指定的 Node 节点上,会跳过 Scheduler 的调度策略,该匹配规则是强制匹配

- [root@master demo]# vim myapp.yaml

- apiVersion: extensions/v1beta1

- kind: Deployment

- metadata:

- name: myapp

- spec:

- replicas: 3

- template:

- metadata:

- labels:

- app: myapp

- #调度到nodeName为 node01 的节点

- spec:

- nodeName: node01

- containers:

- - name: myapp

- image: soscscs/myapp:v1

- ports:

- - containerPort: 80

- [root@master demo]# kubectl apply -f myapp.yaml

- deployment.extensions/myapp created

- [root@master demo]# kubectl get pods -owide

- NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

- myapp-786c9896f9-nvqpc 1/1 Running 0 9s 10.244.1.82 node01

- myapp-786c9896f9-qnmbz 1/1 Running 0 9s 10.244.1.81 node01

- myapp-786c9896f9-xl4tv 1/1 Running 0 9s 10.244.1.83 node01

- #查看详细事件(发现未经过 scheduler 调度分配)

- [root@master demo]# kubectl describe pod myapp-786c9896f9-nvqpc

② 使用nodeSelector强制约束

pod.spec.nodeSelector:通过 kubernetes 的 label-selector 机制选择节点,由调度器调度策略匹配 label,然后调度 Pod 到目标节点,该匹配规则属于强制约束

获取标签帮助

kubectl label --help

Usage:

kubectl label [–overwrite] (-f FILENAME | TYPE NAME) KEY_1=VAL_1 … KEY_N=VAL_N [–resource-version=version] [options]

- #获取node的NAME名称

- root@master demo]# kubectl get node

- NAME STATUS ROLES AGE VERSION

- master Ready master 6d22h v1.15.1

- node01 Ready

6d22h v1.15.1 - node02 Ready

6d22h v1.15.1 - #给对应的 node 设置标签分别为 apps=a; apps=b

- [root@master demo]# kubectl label nodes node01 apps=a

- node/node01 labeled

- [root@master demo]# kubectl label nodes node02 apps=b

- node/node02 labeled

- #查看节点的标签

- [root@master demo]# kubectl get nodes --show-labels

- [root@master demo]# vim myapp.yaml

- apiVersion: extensions/v1beta1

- kind: Deployment

- metadata:

- name: myapp1

- spec:

- replicas: 3

- template:

- metadata:

- labels:

- app: myapp

- spec:

- #调度到标签为 apps=a的节点上

- nodeSelector:

- apps: a

- containers:

- - name: myapp1

- image: soscscs/myapp:v1

- ports:

- - containerPort: 80

- [root@master demo]# kubectl describe pod myapp1-74ff9cd55c-6lw7v

- [root@master demo]# kubectl apply -f myapp.yaml

- deployment.extensions/myapp1 created

- #查看详细信息,通过事件可以发现要先经过scheduler调度

- [root@master demo]# kubectl get pods -o wide

- NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

- myapp1-74ff9cd55c-6lw7v 1/1 Running 0 16s 10.244.1.86 node01

- myapp1-74ff9cd55c-n6r6h 1/1 Running 0 16s 10.244.1.84 node01

- myapp1-74ff9cd55c-zvv2l 1/1 Running 0 16s 10.244.1.85 node01

(5)修改,删除,查询label

- #修改node02 的标签, 将标签修改为apps=c

- [root@master demo]# kubectl label nodes node02 apps=c --overwrite

- node/node02 labeled

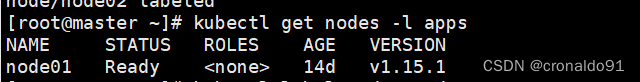

- #查看节点的标签为 apps 的节点

- [root@master demo]# kubectl get nodes -l apps

- NAME STATUS ROLES AGE VERSION

- node01 Ready

6d22h v1.15.1 - node02 Ready

6d22h v1.15.1 - #查看节点标签为 apps=c的节点

- [root@master demo]# kubectl get nodes -l apps=c

- NAME STATUS ROLES AGE VERSION

- node02 Ready

6d22h v1.15.1 - #删除节点node02 的标签 apps

- [root@master demo]# kubectl label nodes node02 apps-

- node/node02 labeled

- [root@master demo]# kubectl get nodes -l apps

- NAME STATUS ROLES AGE VERSION

- node01 Ready

6d22h v1.15.1 - #删除节点node01 的标签apps

- [root@master demo]# kubectl label nodes node01 apps-

- node/node01 labeled

- [root@master demo]# kubectl get nodes -l apps

- No resources found.

2.亲和性

(1)节点亲和性和Pod亲和性

① 节点亲和性

- pod.spec.nodeAffinity

- preferredDuringSchedulingIgnoredDuringExecution:软策略

- requiredDuringSchedulingIgnoredDuringExecution:硬策略

②Pod亲和性

- pod.spec.affinity.podAffinity/podAntiAffinity

- preferredDuringSchedulingIgnoredDuringExecution:软策略

- requiredDuringSchedulingIgnoredDuringExecution:硬策略

(2)键值运算关系

(3)示例

- #查看节点的标签

- [root@master demo]# kubectl get nodes --show-labels

- NAME STATUS ROLES AGE VERSION LABELS

- master Ready master 6d22h v1.15.1 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=master,kubernetes.io/os=linux,node-role.kubernetes.io/master=

- node01 Ready

6d22h v1.15.1 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node01,kubernetes.io/os=linux - node02 Ready

6d22h v1.15.1 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node02,kubernetes.io/os=linux

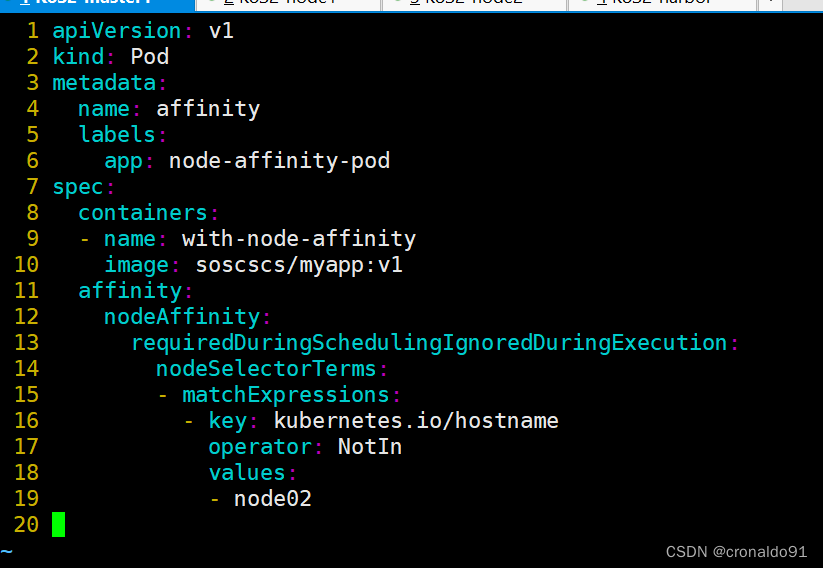

① 硬策略

- [root@master demo]# vim pod1.yaml

- apiVersion: v1

- kind: Pod

- metadata:

- name: affinity

- labels:

- app: node-affinity-pod

- spec:

- containers:

- - name: with-node-affinity

- image: soscscs/myapp:v1

- affinity:

- nodeAffinity:

- requiredDuringSchedulingIgnoredDuringExecution:

- nodeSelectorTerms:

- - matchExpressions:

- #指定node的标签

- - key: kubernetes.io/hostname

- #设置Pod安装到kubernetes.io/hostname 的标签值不在valus列表中的node上

- operator: NotIn

- values:

- - node02

- [root@master demo]# kubectl apply -f pod1.yaml

- pod/affinity created

- [root@master demo]# kubectl get pods -o wide

- NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

- affinity 1/1 Running 0 9s 10.244.1.94 node01

- [root@master demo]# vim pod1.yaml

- apiVersion: v1

- kind: Pod

- metadata:

- name: affinity

- labels:

- app: node-affinity-pod

- spec:

- containers:

- - name: with-node-affinity

- image: soscscs/myapp:v1

- affinity:

- nodeAffinity:

- requiredDuringSchedulingIgnoredDuringExecution:

- nodeSelectorTerms:

- - matchExpressions:

- - key: kubernetes.io/hostname

- #设置Pod安装到kubernetes.io/hostname的标签值在values列表中的node上

- operator: In

- values:

- #当前调度node没有node03

- - node03

- #硬策略不满足条件,Pod 状态一直会处于 Pending 状态。

- kubectl delete pod --all && kubectl apply -f pod1.yaml && kubectl get pods -o wide

② 软策略

- [root@master demo]# vim pod2.yaml

- apiVersion: v1

- kind: Pod

- metadata:

- name: affinity

- labels:

- app: node-affinity-pod

- spec:

- containers:

- - name: with-node-affinity

- image: soscscs/myapp:v1

- affinity:

- nodeAffinity:

- preferredDuringSchedulingIgnoredDuringExecution:

- #如果有多个软策略选项的话,权重越大,优先级越高

- - weight: 1

- preference:

- matchExpressions:

- - key: kubernetes.io/hostname

- operator: In

- values:

- - node03

[root@master demo]# kubectl get pods -o wide- [root@master demo]# vim pod2.yaml

- apiVersion: v1

- kind: Pod

- metadata:

- name: affinity

- labels:

- app: node-affinity-pod

- spec:

- containers:

- - name: with-node-affinity

- image: soscscs/myapp:v1

- affinity:

- nodeAffinity:

- preferredDuringSchedulingIgnoredDuringExecution:

- - weight: 1

- preference:

- matchExpressions:

- - key: kubernetes.io/hostname

- operator: In

- values:

- - node02

[root@master demo]# kubectl delete pod --all && kubectl apply -f pod2.yaml && kubectl get pods -o wide③ 软策略和硬策略一起使用

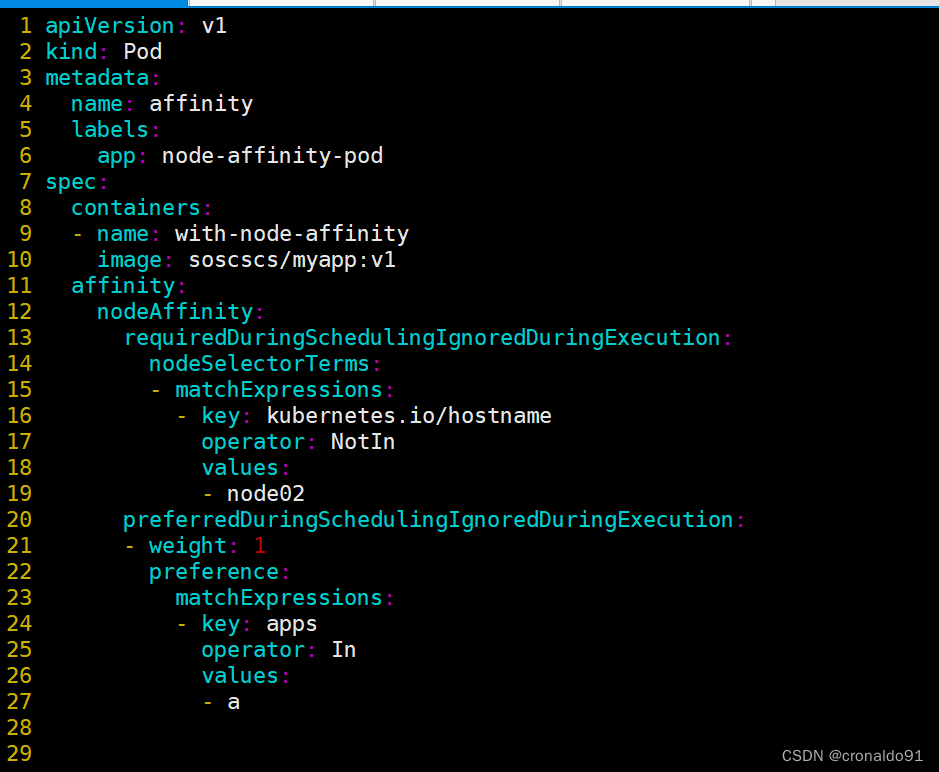

如果把硬策略和软策略合在一起使用,则要先满足硬策略之后才会满足软策略

- apiVersion: v1

- kind: Pod

- metadata:

- name: affinity

- labels:

- app: node-affinity-pod

- spec:

- containers:

- - name: with-node-affinity

- image: soscscs/myapp:v1

- affinity:

- nodeAffinity:

- requiredDuringSchedulingIgnoredDuringExecution: #先满足硬策略,排除有kubernetes.io/hostname=node02标签的节点

- nodeSelectorTerms:

- - matchExpressions:

- - key: kubernetes.io/hostname

- operator: NotIn

- values:

- - node02

- preferredDuringSchedulingIgnoredDuringExecution: #再满足软策略,优先选择有kgc=a标签的节点

- - weight: 1

- preference:

- matchExpressions:

- - key: apps

- operator: In

- values:

- - a

(4)亲和性和反亲和

- [root@master demo]# vim pod3.yaml

- apiVersion: v1

- kind: Pod

- metadata:

- name: myapp01

- labels:

- app: myapp01

- spec:

- containers:

- - name: with-node-affinity

- image: soscscs/myapp:v1

- [root@master demo]# kubectl apply -f pod3.yaml

- pod/myapp01 created

- [root@master demo]# kubectl get pods --show-labels

- NAME READY STATUS RESTARTS AGE LABELSd

- myapp01 1/1 Running 0 22s app=myapp01

- [root@master demo]# kubectl get nodes --show-labels

① pod 亲和性

- [root@master demo]# vim pod4.yaml

- apiVersion: v1

- kind: Pod

- metadata:

- name: myapp02

- labels:

- app: myapp02

- spec:

- containers:

- - name: myapp02

- image: soscscs/myapp:v1

- affinity:

- #pod亲和策略

- podAffinity:

- #硬策略

- requiredDuringSchedulingIgnoredDuringExecution:

- - labelSelector:

- matchExpressions:

- - key: app

- operator: In

- values:

- - myapp01

- #拓扑域

- topologyKey: kubernetes.io/hostname

- 当存在pod 拥有键app,值为myapp01时,(暂时称这个pod为X),其所在节点的 kubernetes.io/hostname 值,就成为了新pod调度的依据。(kubernetes.io/hostname 是由字段topologyKey 定义的 )

- 新pod调度的节点,其kubernetes.io/hostname值必须和 pod X 所在节点的kubernetes.io/hostname值一致

仅当节点和至少一个已运行且有键为“app”且值为“myapp01”的标签 的 Pod 处于同一拓扑域时,才可以将该 Pod 调度到节点上。 (更确切的说,如果节点 N 具有带有键 kubernetes.io/hostname 和某个值 V 的标签,则 Pod 有资格在节点 N 上运行

- [root@master demo]# kubectl apply -f pod4.yaml

- [root@master demo]# kubectl get pods --show-labels -o wide

- NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

- affinity 1/1 Running 0 122m 10.244.1.100 node01

app=node-affinity-pod - myapp01 1/1 Running 0 114m 10.244.2.74 node02

app=myapp01 - myapp02 1/1 Running 0 46m 10.244.2.75 node02

app=myapp02

, 以便集群中至少有一个节点具有键 kubernetes.io/hostname 和值为 V 的节点正在运行具有键“app”和值 “myapp01”的标签的 pod。)

topologyKey 是节点标签的键。如果两个节点使用此键标记并且具有相同的标签值,则调度器会将这两个节点视为处于同一拓扑域中。 调度器试图在每个拓扑域中放置数量均衡的 Pod。

如果 kubernetes.io/hostname 对应的值不一样就是不同的拓扑域。比如 Pod1 在 kubernetes.io/hostname=node01 的 Node 上,Pod2 在 kubernetes.io/hostname=node02 的 Node 上,Pod3 在 kubernetes.io/hostname=node01 的 Node 上,则 Pod2 和 Pod1、Pod3 不在同一个拓扑域,而Pod1 和 Pod3在同一个拓扑域。

② pod 反亲和性调度

- [root@master demo]# vim pod5.yaml

- apiVersion: v1

- kind: Pod

- metadata:

- name: myapp03

- labels:

- app: myapp03

- spec:

- containers:

- - name: myapp03

- image: soscscs/myapp:v1

- affinity:

- #Pod反亲和

- podAntiAffinity:

- #软策略

- preferredDuringSchedulingIgnoredDuringExecution:

- - weight: 100

- podAffinityTerm:

- labelSelector:

- matchExpressions:

- - key: app

- operator: In

- values:

- - myapp01

- topologyKey: kubernetes.io/hostname

如果节点处于 Pod 所在的同一拓扑域且具有键“app”和值“myapp01”的标签, 则该 pod 不应将其调度到该节点上。 (如果 topologyKey 为 kubernetes.io/hostname,则意味着当节点和具有键 “app”和值“myapp01”的 Pod 处于相同的区域,Pod 不能被调度到该节点上。)

即:当某个pod拥有键 app,值为myapp01 的标签时(称此pod为X),就不将新pod 调度到和pod X处于 同一个拓扑域的节点(即拥有相同的 topologyKey: kubernetes.io/hostname值 )

- [root@master demo]# kubectl apply -f pod5.yaml

- pod/myapp03 created

- [root@master demo]# kubectl get pods --show-labels -o wide

- NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES LABELS

- affinity 1/1 Running 0 136m 10.244.1.100 node01

app=node-affinity-pod - myapp01 1/1 Running 0 128m 10.244.2.74 node02

app=myapp01 - myapp02 1/1 Running 0 60m 10.244.2.75 node02

app=myapp02 - myapp03 1/1 Running 0 20s 10.244.1.101 node01

app=myapp03

node01 节点的topologyKey值为 kubernetes.io/hostname=node01

node02 节点的 topologyKey值为 kubernetes.io/hostname=node02

因此,node01 和node02是两个拓扑域

而拥有标签 app=myapp01 ,的pod myapp01在node02 节点上。,所以,所有topologyKey值为 kubernetes.io/hostname=node02的节点,都不会被该新pod 选择。

因此,该pod被调度到了 node01上

二、实验

1. 指定调度节点

(1) 使用nodeName 强制匹配

生成资源

查看信息

查看详细事件

发现未经过 scheduler 调度分配

发现未经过 scheduler 调度分配

(2) 使用nodeSelector强制约束

获取node的NAME名称

给对应的 node 设置标签分别为 apps=a; apps=b

查看节点的标签

修改资源清单

生成资源

查看详细信息,都调度到了node01上

通过事件可以发现要先经过scheduler调度

(3)修改,删除,查询label

修改node02 的标签, 将标签修改为apps=c

查看节点的标签为 apps 的节点

查看节点标签为 apps=c的节点

删除节点node02 的标签 apps

查看节点的标签为 apps 的节点,只有node01

删除节点node01 的标签apps

查看节点的标签为 apps 的节点,显示没有资源

2.节点亲和性

(1)示例

(2)硬策略

编写资源清单

生成资源

查看pod信息,调度到了node01

重建pod,仍然调度到了node01

硬策略不满足条件,Pod 状态一直会处于 Pending 状态。

没有适合的node节点,所以是pending

(3)软策略

编写资源清单

生成资源

因为是软策略,所以即使是没有符合要求的node节点,也会调度pod到其他节点,运行容器

修改资源清单配置文件

根据软策略,调度到了node02

(3)软策略和硬策略一起使用

编写资源清单文件

生成资源并查看

3.亲和性和反亲和

(1)示例

编写资源清单

生成资源

查看pod与node信息

(2)pod 亲和性

编写资源清单文件

生成资源并查看pod信息

(3)pod 反亲和性调度

编写资源清单文件

生成资源

并查看信息

当某个pod拥有键 app,值为myapp01 的标签时(称此pod为X),就不将新pod 调度到和pod X处于 同一个拓扑域的节点(即拥有相同的 topologyKey: kubernetes.io/hostname值 )

node01 节点的topologyKey值为 kubernetes.io/hostname=node01

node02 节点的 topologyKey值为 kubernetes.io/hostname=node02

因此,node01 和node02是两个拓扑域

而拥有标签 app=myapp01 ,的pod myapp01在node01 节点上。,所以,所有topologyKey值为 kubernetes.io/hostname=node01的节点,都不会被该新pod 选择。

因此,该pod被调度到了 node02上三、问题

1.新生成pod一直为pending

(1)报错

(2)原因分析

没有可调度的节点

(3)解决方法

修改资源清单文件的调度标签选项

修改前:

修改后:

成功:

2.如何一次性删除pod和deployment

(1) 删除所有pod命令

[root@master ~]# kubectl delete pod --all

(2)删除所有deployment命令

[root@master ~]# kubectl delete deployment --all

3.pod亲和性资源报错

(1)报错

(2)原因分析

无pod亲和策略关键字”podAffinity“

(3)解决方法

添加关键字”podAffinity“

修改前:

修改后:

4.pod反亲和性资源报错

(1)报错

(2)原因分析

无标签选择器关键字”labelSelector“、关键字”weight“错误

(3)解决方法

添加标签选择器关键字”labelSelector“、修改关键字”weight“

修改前:

修改后:

成功

四、总结

有三个 List-Watch,分别是 Controller Manager(运行在 Master),Scheduler(运行在 Master),kubelet(运行在 Node)。他们在进程已启动就会监听(Watch)APIServer 发出来的事件。

pod.spec.nodeName 将 Pod 直接调度到指定的 Node 节点上,会跳过 Scheduler 的调度策略,该匹配规则是强制匹配。

topologyKey 是节点标签的键,值为node节点名称(例如node01、node02等)。如果 kubernetes.io/hostname 对应的值不一样就是不同的拓扑域。

节点亲和性:

- pod.spec.nodeAffinity

- preferredDuringSchedulingIgnoredDuringExecution:软策略

- requiredDuringSchedulingIgnoredDuringExecution:硬策略

Pod亲和性

- pod.spec.affinity.podAffinity/podAntiAffinity

- preferredDuringSchedulingIgnoredDuringExecution:软策略

- requiredDuringSchedulingIgnoredDuringExecution:硬策略

topologyKey用于指定调度的作用域,例如:

-

- 如果指定为kubernetes.io/hostname,那就是以Node节点为区分范围。

- 如果指定为beta.kubernetes.io/os,则以Node节点的操作系统类型来区分。

-

-

相关阅读:

天翼云打造国云安全品牌 铸牢企业云上安全防线

10、内网安全-横向移动&域控提权&NetLogon&ADCS&PAC&KDC&永恒之蓝

Vue——vue3中的ref和reactive数据理解以及父子组件之间props传递的数据

倍增(小试牛刀)

Docker安装mysql & redis

最新的Cesium和Three的整合方法(附完整代码)

ALTERA FPGA IPCORE核之FIFO详细教程

ElasticSearch查询工具类分享

HTML—CSS盒子模型(Box Model)

基于Java的图书商城管理系统设计与实现(源码+lw+部署文档+讲解等)

- 原文地址:https://blog.csdn.net/cronaldo91/article/details/132966120