-

深度学习 Day 19——数据增强

深度学习 Day 19——数据增强

一、前言

- 🍨 本文为🔗365天深度学习训练营 中的学习记录博客

- 🍦 参考文章:365天深度学习训练营-第10周:数据增强(训练营内部成员可读)

- 🍖 原作者:K同学啊|接辅导、项目定制

在上一期博客中我们了解到了一些有关数据增强的相关知识,本期博客我们就来学习如何实际的进行数据增强,并通过数据增强用少量的数据达到非常好的识别准确率。

我们将介绍两种数据增强的方式,以及如何自定义数据增强的方式并将其放到我们的代码中去实现,两种数据增强的方式如下:

- 将数据增强模块嵌入到model中

- 在Dataset数据集中进行数据增强

二、我的环境

- 电脑系统:Windows 11

- 语言环境:Python 3.8.5

- 编译器:DataSpell 2022.2

- 深度学习环境:TensorFlow 2.3.4

- 显卡及显存:RTX 3070 8G

三、前期工作

1、导入依赖项并设置GPU

和之前一样,如果你GPU很好就只使用GPU进行训练,如果GPU不行就推荐使用CPU训练加GPU加速。

只使用GPU:

import matplotlib.pyplot as plt import numpy as np #隐藏警告 import warnings warnings.filterwarnings('ignore') from tensorflow.keras import layers import tensorflow as tf gpus = tf.config.list_physical_devices("GPU") if gpus: tf.config.experimental.set_memory_growth(gpus[0], True) #设置GPU显存用量按需使用 tf.config.set_visible_devices([gpus[0]],"GPU") # 打印显卡信息,确认GPU可用 print(gpus)- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

[PhysicalDevice(name='/physical_device:GPU:0', device_type='GPU')]- 1

使用CPU+GPU:

os.environ["CUDA_VISIBLE_DEVICES"] = "-1"- 1

2、加载数据

我们使用image_dataset_from_directory方法将我们本地的数据加载到tf.data.Dataset

中,并设置训练图片模型参数:

data_dir = "E:\DL_DATA\Day19" img_height = 224 img_width = 224 batch_size = 32 train_ds = tf.keras.preprocessing.image_dataset_from_directory( data_dir, validation_split=0.3, subset="training", seed=12, image_size=(img_height, img_width), batch_size=batch_size) val_ds = tf.keras.preprocessing.image_dataset_from_directory( data_dir, validation_split=0.3, subset="training", seed=12, image_size=(img_height, img_width), batch_size=batch_size)- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

Found 3400 files belonging to 2 classes. Using 2380 files for training. Found 3400 files belonging to 2 classes. Using 2380 files for training.- 1

- 2

- 3

- 4

由于原始数据集不包含测试集,因此需要创建一个。使用 tf.data.experimental.cardinality 确定验证集中有多少批次的数据,然后将其中的 20% 移至测试集。

val_batches = tf.data.experimental.cardinality(val_ds) test_ds = val_ds.take(val_batches // 5) val_ds = val_ds.skip(val_batches // 5) print('Number of validation batches: %d' % tf.data.experimental.cardinality(val_ds)) print('Number of test batches: %d' % tf.data.experimental.cardinality(test_ds))- 1

- 2

- 3

- 4

- 5

- 6

Number of validation batches: 60 Number of test batches: 15- 1

- 2

然后我们查看一下文件标签:

class_names = train_ds.class_names print(class_names)- 1

- 2

['cat', 'dog']- 1

可以看见一共有猫狗两类数据集。

3、配置数据集并进行归一化处理

AUTOTUNE = tf.data.experimental.AUTOTUNE def preprocess_image(image,label): return (image/255.0,label) # 归一化处理 train_ds = train_ds.map(preprocess_image, num_parallel_calls=AUTOTUNE) val_ds = val_ds.map(preprocess_image, num_parallel_calls=AUTOTUNE) test_ds = test_ds.map(preprocess_image, num_parallel_calls=AUTOTUNE) train_ds = train_ds.cache().shuffle(1000).prefetch(buffer_size=AUTOTUNE) val_ds = val_ds.cache().prefetch(buffer_size=AUTOTUNE)- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

4、可视化数据

plt.figure(figsize=(15, 10)) # 图形的宽为15高为10 for images, labels in train_ds.take(1): for i in range(8): ax = plt.subplot(5, 8, i + 1) plt.imshow(images[i]) plt.title(class_names[labels[i]]) plt.axis("off")- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

四、数据增强

我们可以使用

tf.keras.layers.experimental.preprocessing.RandomFlip与tf.keras.layers.experimental.preprocessing.RandomRotation进行数据增强。tf.keras.layers.experimental.preprocessing.RandomFlip:水平和垂直随机翻转每个图像tf.keras.layers.experimental.preprocessing.RandomRotation:随机旋转每个图像

data_augmentation = tf.keras.Sequential([ tf.keras.layers.experimental.preprocessing.RandomFlip("horizontal_and_vertical"), tf.keras.layers.experimental.preprocessing.RandomRotation(0.2), ])- 1

- 2

- 3

- 4

第一层表示进行随机的水平和垂直翻转,而第二层表示按照 0.2 的弧度值进行随机旋转。

# 将图像添加到批次 image = tf.expand_dims(images[i], 0)- 1

- 2

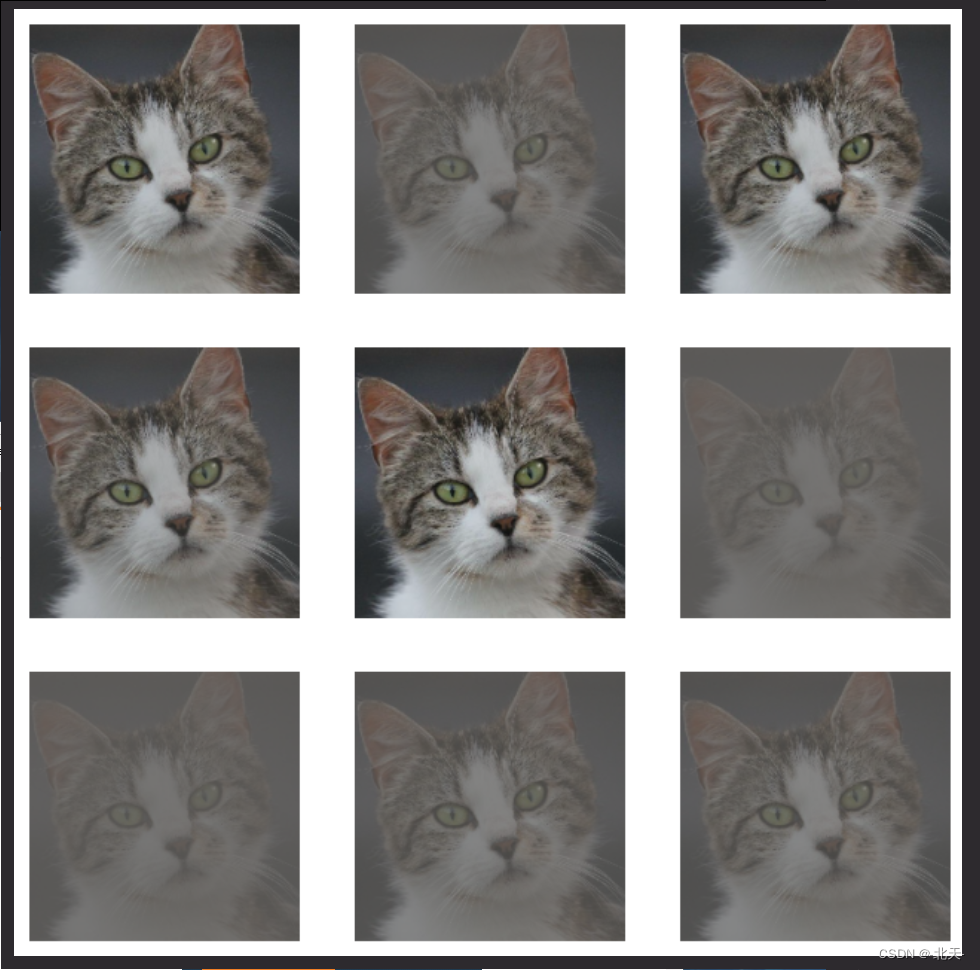

我们随机使用一张照片尝试一下看看效果:

plt.figure(figsize=(8, 8)) for i in range(9): augmented_image = data_augmentation(image) ax = plt.subplot(3, 3, i + 1) plt.imshow(augmented_image[0]) plt.axis("off")- 1

- 2

- 3

- 4

- 5

- 6

五、数据增强方式

1、将其签入model中

model = tf.keras.Sequential([ data_augmentation, layers.Conv2D(16, 3, padding='same', activation='relu'), layers.MaxPooling2D(), ])- 1

- 2

- 3

- 4

- 5

这个方法的好处就是数据增强这块的工作可以得到GPU的加速(如果你使用了GPU训练的话),但是只有在模型训练时(Model.fit)才会进行增强,在模型评估(Model.evaluate)以及预测(Model.predict)时并不会进行增强操作。

2、在Dataset数据集中进行数据增强

batch_size = 32 AUTOTUNE = tf.data.AUTOTUNE def prepare(ds): ds = ds.map(lambda x, y: (data_augmentation(x, training=True), y), num_parallel_calls=AUTOTUNE) return ds- 1

- 2

- 3

- 4

- 5

- 6

train_ds = prepare(train_ds)- 1

我在这里遇见了一个异常:NotImplementedError: Cannot convert a symbolic Tensor (sequential_10/random_rotation_5/rotation_matrix/strided_slice:0) to a numpy array. This error may indicate that you’re trying to pass a Tensor to a NumPy call, which is not supported

这个问题的出现是版本不兼容,我原来的TensorFlow版本是2.3.4,numpy版本是1.18.5,我将两者进行了升级,升级后对应的TensorFlow版本是2.4.0,numpy版本是1.19.5,这样问题就解决了。

六、编译模型

在准备对模型进行训练之前,还需要再对其进行一些设置。以下内容是在模型的编译步骤中添加的:

- 损失函数(loss):用于衡量模型在训练期间的准确率。

- 优化器(optimizer):决定模型如何根据其看到的数据和自身的损失函数进行更新。

- 评价函数(metrics):用于监控训练和测试步骤。以下示例使用了准确率,即被正确分类的图像的比率。

model.compile(optimizer='adam', loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True), metrics=['accuracy'])- 1

- 2

- 3

七、训练模型

model = tf.keras.Sequential([ layers.Conv2D(16, 3, padding='same', activation='relu'), layers.MaxPooling2D(), layers.Conv2D(32, 3, padding='same', activation='relu'), layers.MaxPooling2D(), layers.Conv2D(64, 3, padding='same', activation='relu'), layers.MaxPooling2D(), layers.Flatten(), layers.Dense(128, activation='relu'), layers.Dense(len(class_names)) ])- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

epochs=20 history = model.fit( train_ds, validation_data=val_ds, epochs=epochs )- 1

- 2

- 3

- 4

- 5

- 6

训练的结果如下:

Epoch 1/20 75/75 [==============================] - 22s 289ms/step - loss: 0.6459 - accuracy: 0.6958 - val_loss: 0.3205 - val_accuracy: 0.8668 Epoch 2/20 75/75 [==============================] - 23s 305ms/step - loss: 0.2935 - accuracy: 0.8765 - val_loss: 0.2129 - val_accuracy: 0.9179 Epoch 3/20 75/75 [==============================] - 23s 308ms/step - loss: 0.1988 - accuracy: 0.9277 - val_loss: 0.1838 - val_accuracy: 0.9226 ... Epoch 18/20 75/75 [==============================] - 27s 351ms/step - loss: 0.0549 - accuracy: 0.9811 - val_loss: 0.0644 - val_accuracy: 0.9768 Epoch 19/20 75/75 [==============================] - 25s 329ms/step - loss: 0.0464 - accuracy: 0.9836 - val_loss: 0.0428 - val_accuracy: 0.9816 Epoch 20/20 75/75 [==============================] - 23s 299ms/step - loss: 0.0550 - accuracy: 0.9819 - val_loss: 0.0347 - val_accuracy: 0.9874- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

查看一下最终准确率:

loss, acc = model.evaluate(test_ds) print("Accuracy", acc)- 1

- 2

15/15 [==============================] - 1s 51ms/step - loss: 0.0375 - accuracy: 0.9854 Accuracy 0.9854166507720947- 1

- 2

八、自定义增强函数

import random # 这是大家可以自由发挥的一个地方 def aug_img(image): seed = (random.randint(0,9), 0) # 随机改变图像对比度 stateless_random_brightness = tf.image.stateless_random_contrast(image, lower=0.1, upper=1.0, seed=seed) return stateless_random_brightness- 1

- 2

- 3

- 4

- 5

- 6

- 7

image = tf.expand_dims(images[3]*255, 0) print("Min and max pixel values:", image.numpy().min(), image.numpy().max())- 1

- 2

Min and max pixel values: 14.000048 253.28577- 1

我们随机使用一张图片看看改变对比度的效果:

plt.figure(figsize=(8, 8)) for i in range(9): augmented_image = aug_img(image) ax = plt.subplot(3, 3, i + 1) plt.imshow(augmented_image[0].numpy().astype("uint8")) plt.axis("off")- 1

- 2

- 3

- 4

- 5

- 6

- 7

我们还可以尝试改变图像的饱和度:

image = tf.expand_dims(images[3]*255, 0) saturated = tf.image.adjust_saturation(image, 3) plt.figure(figsize=(8, 8)) for i in range(9): augmented_image = aug_img(saturated) ax = plt.subplot(3, 3, i + 1) plt.imshow(augmented_image[0].numpy().astype("uint8")) plt.axis("off")- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

再尝试对图像进行裁剪:

image = tf.expand_dims(images[3]*255, 0) cropped = tf.image.central_crop(image, central_fraction=0.5) plt.figure(figsize=(8, 8)) for i in range(9): augmented_image = aug_img(cropped) ax = plt.subplot(3, 3, i + 1) plt.imshow(augmented_image[0].numpy().astype("uint8")) plt.axis("off")- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

我们可以通过上文的

preprocess_image函数,将aug_img函数嵌入到preprocess_image函数中,在数据预处理时完成自定义数据增强。九、最后我想说

上面提到的tf.keras.layers.experimental.preprocessing.RandomFlip函数与 tf.keras.layers.experimental.preprocessing.RandomRotation函数,大家可以去官方文档上查看它们的函数原型以及详细介绍。

而且里面还有更多其他的数据增强的方式,大家可以去学习一下。

-

相关阅读:

华为mate50和华为mate50pro区别 华为mate50和华为mate50pro参数对比

【苹果iMessage家庭推群发】Notification Service Extension 来修改推送通知内容的技术

aspnet zero core 11.3.0 Crack

@Value的注入与静态注入 与 组件中静态工具类的注入

【C++ Primer Plus学习记录】指针——使用new来创建动态数组

协议定制 + Json序列化反序列化

Apache 原生 Hadoop 运维命令

React 全栈体系(五)

MacBook 上运行火影忍者,下载安装详细教程仅需简单三步

联想服务配置

- 原文地址:https://blog.csdn.net/qq_52417436/article/details/127918981