-

Docker consul

一、consul服务更新和服务发现

什么是服务注册与发现

服务注册与发现是微服务架构中不可或缺的重要组件。起初服务都是单节点的,不保障高可用性,也不考虑服务的压力承载,服务之间调用单纯的通过接口访问。直到后来出现了多个节点的分布式架构,起初的解决手段是在服务前端负载均衡,这样前端必须要知道所有后端服务的网络位置,并配置在配置文件中。这里就会有几个问题:

●如果需要调用后端服务A-N,就需要配置N个服务的网络位置,配置很麻烦

●后端服务的网络位置变化,都需要改变每个调用者的配置既然有这些问题,那么服务注册与发现就是解决这些问题的。后端服务A-N可以把当前自己的网络位置注册到服务发现模块,服务发现就以K-V的方式记录下来,K一般是服务名,V就是IP:PORT。服务发现模块定时的进行健康检查,轮询查看这些后端服务能不能访问的了。前端在调用后端服务A-N的时候,就跑去服务发现模块问下它们的网络位置,然后再调用它们的服务。这样的方式就可以解决上面的问题了,前端完全不需要记录这些后端服务的网络位置,前端和后端完全解耦!

什么是consul

consul是google开源的一个使用go语言开发的服务管理软件。支持多数据中心、分布式高可用的、服务发现和配置共享。采用Raft算法,用来保证服务的高可用。内置了服务注册与发现框架、分布一致性协议实现、健康检查、Key/Value存储、多数据中心方案,不再需要依赖其他工具(比如ZooKeeper等)。服务部署简单,只有一个可运行的二进制的包。每个节点都需要运行agent,他有两种运行模式server 和 client。 每个数据中心官方建议需要3或5个server节点以保证数据安全,同时保证server-leader的选举能够正确的进行。

在client模式下,所有注册到当前节点的服务会被转发到server节点,本身是不持久化这些信息。

在server模式下,功能和client模式相似,唯一不同的是,它会把所有的信息持久化到本地,这样遇到故障,信息是可以被保留的。

server-leader是所有server节点的老大,它和其它server节点不同的是,它需要负责同步注册的信息给其它的server节点,同时也要负责各个节点的健康监测。consul提供的一些关键特性:

服务注册与发现:consul通过DNS或者HTTP接口使服务注册和服务发现变的很容易,一些外部服务,例如saas提供的也可以一样注册。

健康检查:健康检测使consul可以快速的告警在集群中的操作。和服务发现的集成,可以防止服务转发到故障的服务上面。

Key/Value存储:一个用来存储动态配置的系统。提供简单的HTTP接口,可以在任何地方操作。

多数据中心:无需复杂的配置,即可支持任意数量的区域。

安装consul是用于服务注册,也就是容器本身的一些信息注册到consul里面,其他程序可以通过consul获取注册的相关服务信息,这就是服务注册与发现。二、consul 部署

consul服务器 192.168.146.20 运行consul服务、nginx服务、consul-template守护进程

registrator服务器 192.168.146.30 运行registrator容器、运行nginx容器consul服务器

1. 建立 Consul 服务

mkdir /opt/consul

#上传软件包并解压

cd /opt/consul

unzip consul_0.9.2_linux_amd64.zip

#解压完就是一个可执行文件

mv consul /usr/local/bin/

//设置代理,在后台启动 consul 服务端

consul agent \

-server \

-bootstrap \

-ui \

-data-dir=/var/lib/consul-data \

-bind=192.168.146.20 \

-client=0.0.0.0 \

-node=consul-server01 &> /var/log/consul.log &

-server: 以server身份启动。默认是client。

-bootstrap :用来控制一个server是否在bootstrap模式,在一个数据中心中只能有一个server处于bootstrap模式,当一个server处于 bootstrap模式时,可以自己选举为 server-leader。

-bootstrap-expect=2 :集群要求的最少server数量,当低于这个数量,集群即失效。

-ui :指定开启 UI 界面,这样可以通过 http://localhost:8500/ui 这样的地址访问 consul 自带的 web UI 界面。

-data-dir :指定数据存储目录。

-bind :指定用来在集群内部的通讯地址,集群内的所有节点到此地址都必须是可达的,默认是0.0.0.0。

-client :指定 consul 绑定在哪个 client 地址上,这个地址提供 HTTP、DNS、RPC 等服务,默认是 127.0.0.1。

-node :节点在集群中的名称,在一个集群中必须是唯一的,默认是该节点的主机名。

-datacenter :指定数据中心名称,默认是dc1。netstat -natp | grep consul

启动consul后默认会监听5个端口:

8300:replication、leader farwarding的端口

8301:lan cossip的端口

8302:wan gossip的端口

8500:web ui界面的端口

8600:使用dns协议查看节点信息的端口

2. 查看集群信息

#查看members状态

consul members

Node Address Status Type Build Protocol DC

consul-server01 192.168.146.20:8301 alive server 0.9.2 2 dc1

查看集群状态

[root@localhost consul]# consul operator raft list-peers

Node ID Address State Voter RaftProtocol

consul-server01 192.168.146.20:8300 192.168.146.20:8300 leader true 2

[root@localhost consul]# consul info | grep leader

leader = true

leader_addr = 192.168.146.20:8300

3. 通过 http api 获取集群信息

curl 127.0.0.1:8500/v1/status/peers #查看集群server成员

curl 127.0.0.1:8500/v1/status/leader #集群 server-leader

curl 127.0.0.1:8500/v1/catalog/services #注册的所有服务

curl 127.0.0.1:8500/v1/catalog/nginx #查看 nginx 服务信息

curl 127.0.0.1:8500/v1/catalog/nodes #集群节点详细信息

registrator服务器

//容器服务自动加入 Nginx 集群

1. 安装 Gliderlabs/Registrator

Gliderlabs/Registrator 可检查容器运行状态自动注册,还可注销 docker 容器的服务到服务配置中心。目前支持 Consul、Etcd 和 SkyDNS2。

docker run -d \

--name=registrator \

--net=host \

-v /var/run/docker.sock:/tmp/docker.sock \

--restart=always \

gliderlabs/registrator:latest \

--ip=192.168.146.30 \

consul://192.168.146.20:8500

-v /var/run/docker.sock:/tmp/docker.sock :

把宿主机的Docker守护进程(Docker daemon)默认监听的Unix域套接字挂载到容器中。

--restart=always :设置在容器退出时总是重启容器。

--ip :刚才把network指定了host模式,所以我们指定ip为宿主机的ip。

consul :指定consul服务器的IP和端口。2. 测试服务发现功能是否正常

docker run -itd -p:83:80 --name test-01 -h test01 nginx

docker run -itd -p:84:80 --name test-02 -h test02 nginx

docker run -itd -p:88:80 --name test-03 -h test03 httpd

docker run -itd -p:89:80 --name test-04 -h test04 httpd

#-h:设置容器主机名3. 验证 http 和 nginx 服务是否注册到 consul

浏览器中,输入 http://192.168.146.20:8500,在 Web 页面中“单击 NODES”,

然后单击“consurl-server01”,会出现 5 个服务。

//在consul服务器使用curl测试连接服务器

curl 127.0.0.1:8500/v1/catalog/services

{"consul":[],"httpd":[],"nginx":[]}

consul-template

Consul-Template是基于Consul的自动替换配置文件的应用。

Consul-Template是一个守护进程,用于实时查询Consul集群信息,

并更新文件系统上任意数量的指定模板,生成配置文件。更新完成以后,

可以选择运行 shell 命令执行更新操作,重新加载 Nginx。

Consul-Template可以查询Consul中的服务目录、Key、Key-values 等。

这种强大的抽象功能和查询语言模板可以使 Consul-Template 特别适合动态的创建配置文件。

例如:创建Apache/Nginx Proxy Balancers 、 Haproxy Backends等。1. 准备 template nginx 模板文件

- //在consul服务器上操作

- vim /opt/consul/nginx.ctmpl

- #定义nginx upstream一个简单模板

- upstream http_backend {

- {{range service "nginx"}}

- server {{.Address}}:{{.Port}};

- {{end}}

- }

- #定义一个server,监听8000端口,反向代理到upstream

- server {

- listen 8000;

- server_name localhost 192.168.146.20;

- access_log /var/log/nginx/kgc.com-access.log; #修改日志路径

- index index.html index.php;

- location / {

- proxy_set_header HOST $host;

- proxy_set_header X-Real-IP $remote_addr;

- proxy_set_header Client-IP $remote_addr;

- proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

- proxy_pass http://http_backend;

- }

- }

2. 编译安装nginx

yum -y install pcre-devel zlib-devel gcc gcc-c++ make

useradd -M -s /sbin/nologin nginx

tar zxvf nginx-1.12.0.tar.gz -C /opt/

cd /opt/nginx-1.12.0/

./configure --prefix=/usr/local/nginx --user=nginx --group=nginx && make && make install

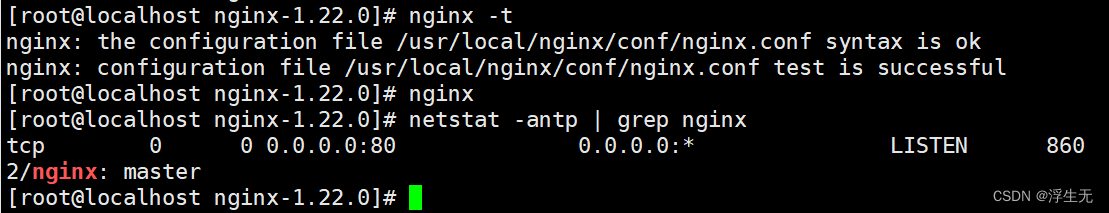

ln -s /usr/local/nginx/sbin/nginx /usr/local/sbin/3. 配置 nginx

vim /usr/local/nginx/conf/nginx.conf

......

http {

include mime.types;

include vhost/*.conf; #添加虚拟主机目录

default_type application/octet-stream;

......

//创建虚拟主机目录

mkdir /usr/local/nginx/conf/vhost

//创建日志文件目录

mkdir /var/log/nginx

//启动nginx

nginx

4. 配置并启动 template

#上传并解压

[root@localhost opt]# unzip consul-template_0.19.3_linux_amd64.zip

Archive: consul-template_0.19.3_linux_amd64.zip

inflating: consul-template

#解压完就是一个可执行文件

[root@localhost opt]# mv consul-template /usr/local/bin/

//在前台启动 template 服务,启动后不要按 ctrl+c 中止 consul-template 进程。

consul-template --consul-addr 192.168.146.20:8500 \

--template "/opt/consul/nginx.ctmpl:/usr/local/nginx/conf/vhost/kgc.conf:/usr/local/nginx/sbin/nginx -s reload" \

--log-level=info

//另外打开一个终端查看生成配置文件

cat /usr/local/nginx/conf/vhost/kgc.conf

upstream http_backend {

server 192.168.146.30:83;

server 192.168.146.30:84;

}

#定义一个server,监听8000端口,反向代理到upstream

server {

listen 8000;

server_name localhost 192.168.146.20;

access_log /var/log/nginx/kgc.com-access.log; #修改日志路径

index index.html index.php;

location / {

proxy_set_header HOST $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header Client-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_pass http://http_backend;

}

}

5. 访问 template-nginx

- docker ps -a

- CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

- 7abad2e0e8bd httpd "httpd-foreground" 39 minutes ago Up 39 minutes 0.0.0.0:89->80/tcp, :::89->80/tcp test-04

- 8feb3873ebc2 httpd "httpd-foreground" 39 minutes ago Up 39 minutes 0.0.0.0:88->80/tcp, :::88->80/tcp test-03

- cfdf0051d561 nginx "/docker-entrypoint.…" 39 minutes ago Up 39 minutes 0.0.0.0:84->80/tcp, :::84->80/tcp test-02

- 3f7d9953df9c nginx "/docker-entrypoint.…" 39 minutes ago Up 39 minutes 0.0.0.0:83->80/tcp, :::83->80/tcp test-01

- 87fb40eeb6b7 gliderlabs/registrator:latest "/bin/registrator --…" 44 minutes ago Up 44 minutes registrator

- docker exec -it 3f7d9953df9c bash

- echo "this is test1 web" > /usr/share/nginx/html/index.html

- docker exec -it cfdf0051d561 bash

- echo "this is test2 web" > /usr/share/nginx/html/index.html

- 浏览器访问:http://192.168.146.20:8000/ ,并不断刷新。

6.测试

- #再次在registrator开两个容器

- docker run -itd -p:85:80 --name test-05 -h test05 nginx

- docker run -itd -p:86:80 --name test-06 -h test06 nginx

- #consul端再次查看文件,两个容器自动添加进来了

- #定义nginx upstream一个简单模板

- cat /usr/local/nginx/conf/vhost/kgc.conf

- upstream http_backend {

- server 192.168.146.30:83;

- server 192.168.146.30:84;

- server 192.168.146.30:85;

- server 192.168.146.30:86;

- }

- #定义一个server,监听8000端口,反向代理到upstream

- server {

- listen 8000;

- server_name localhost 192.168.146.20;

- access_log /var/log/nginx/kgc.com-access.log; #修改日志路径

- index index.html index.php;

- location / {

- proxy_set_header HOST $host;

- proxy_set_header X-Real-IP $remote_addr;

- proxy_set_header Client-IP $remote_addr;

- proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

- proxy_pass http://http_backend;

- }

- }

7.consul 多节点

- //添加一台已有docker环境的服务器192.168.146.40/24加入已有的群集中

- consul agent \

- -server \

- -ui \

- -data-dir=/var/lib/consul-data \

- -bind=192.168.146.40 \

- -client=0.0.0.0 \

- -node=consul-server02 \

- -enable-script-checks=true \

- -datacenter=dc1 \

- -join 192.168.146.20 &> /var/log/consul.log &

- ------------------------------------------------------------------------

- -enable-script-checks=true :设置检查服务为可用

- -datacenter : 数据中心名称

- -join :加入到已有的集群中

- ------------------------------------------------------------------------

- consul members

- Node Address Status Type Build Protocol DC

- consul-server01 192.168.146.20:8301 alive server 0.9.2 2 dc1

- consul-server02 192.168.146.40:8301 alive server 0.9.2 2 dc1

- consul operator raft list-peers

- Node ID Address State Voter RaftProtocol

- consul-server01 192.168.146.20:8300 192.168.146.20:8300 leader true 2

- consul-server02 192.168.146.40:8300 192.168.146.40:8300 follower true 2

-

相关阅读:

无聊的一篇博客(如何通过路由器登陆页对固定机器进行网速干扰,如何帮熊孩子戒网瘾)

HED边缘检测

延时任务-基于redis zset的完整实现

【文献阅读】【NC 2023】基于分子组装的可解释深度学习方法实现精准逆合成预测以及路径规划

ES(Elasticsearch)概述及基本使用方法

OceanBase:在win11 wsl下的Ubuntu中的安装OceanBase Docker版

java框架 Mybatis介绍与入门案例

Mini-Gemini: Mining the Potential of Multi-modality Vision Language Models论文解读

(39)STM32——FLASH闪存

Linux一篇入门(以Ubuntu为例)

- 原文地址:https://blog.csdn.net/weixin_42054864/article/details/133795960